模型:

google/flan-t5-base

英文

英文FLAN-T5基础模型卡

目录

TL;DR

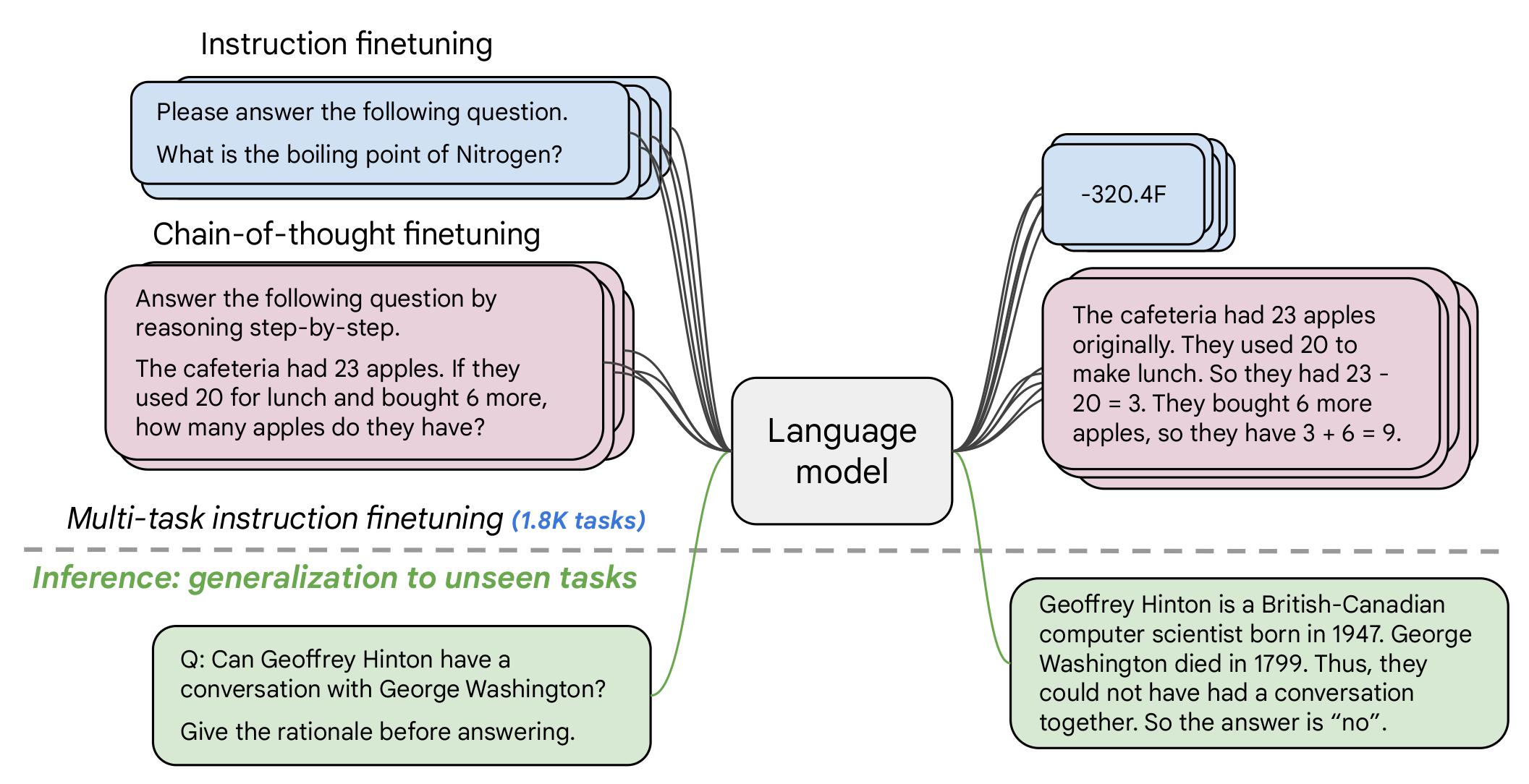

如果你已经了解T5,那么FLAN-T5在各个方面都更胜一筹。对于相同数量的参数,这些模型还在1000多个额外任务上进行了微调,涵盖的语言也更多。正如摘要的前几行所述:

Flan-PaLM 540B在几个基准测试中取得了最先进的性能,例如在五句MMLU上达到75.2%。我们还公开发布了Flan-T5的检查点,1它们即使与更大的模型(如PaLM 62B)相比,也能取得强大的少量样本性能。总体而言,指导微调是一种提高预训练语言模型性能和可用性的通用方法。

免责声明:此模型卡的内容由Hugging Face团队撰写,其中的部分内容是从 T5 model card 复制粘贴的。

模型详细信息

模型描述

- 模型类型:语言模型

- 语言(NLP):英语、西班牙语、日语、波斯语、印地语、法语、汉语、孟加拉语、古吉拉特语、德语、泰卢固语、意大利语、阿拉伯语、波兰语、泰米尔语、马拉地语、马拉雅拉姆语、奥里亚语、旁遮普语、葡萄牙语、乌尔都语、加利西亚语、希伯来语、韩语、加泰罗尼亚语、泰语、荷兰语、印度尼西亚语、越南语、保加利亚语、菲律宾语、高棉语、老挝语、土耳其语、俄语、克罗地亚语、瑞典语、约鲁巴语、库尔德语、缅甸语、马来语、捷克语、芬兰语、索马里语、他加禄语、斯瓦希里语、僧伽罗语、坎纳达语、壮语、伊博语、科萨语、罗马尼亚语、海地语、爱沙尼亚语、斯洛伐克语、立陶宛语、希腊语、尼泊尔语、阿萨姆语、挪威语

- 许可证:Apache 2.0

- 相关模型: All FLAN-T5 Checkpoints

- 原始检查点: All Original FLAN-T5 Checkpoints

- 更多信息资源:

使用方法

以下是如何在转换器中使用模型的一些示例脚本:

使用Pytorch模型

在CPU上运行模型

点击展开

from transformers import T5Tokenizer, T5ForConditionalGeneration

tokenizer = T5Tokenizer.from_pretrained("google/flan-t5-base")

model = T5ForConditionalGeneration.from_pretrained("google/flan-t5-base")

input_text = "translate English to German: How old are you?"

input_ids = tokenizer(input_text, return_tensors="pt").input_ids

outputs = model.generate(input_ids)

print(tokenizer.decode(outputs[0]))

在GPU上运行模型

点击展开# pip install accelerate

from transformers import T5Tokenizer, T5ForConditionalGeneration

tokenizer = T5Tokenizer.from_pretrained("google/flan-t5-base")

model = T5ForConditionalGeneration.from_pretrained("google/flan-t5-base", device_map="auto")

input_text = "translate English to German: How old are you?"

input_ids = tokenizer(input_text, return_tensors="pt").input_ids.to("cuda")

outputs = model.generate(input_ids)

print(tokenizer.decode(outputs[0]))

使用不同精度在GPU上运行模型

FP16 点击展开# pip install accelerate

import torch

from transformers import T5Tokenizer, T5ForConditionalGeneration

tokenizer = T5Tokenizer.from_pretrained("google/flan-t5-base")

model = T5ForConditionalGeneration.from_pretrained("google/flan-t5-base", device_map="auto", torch_dtype=torch.float16)

input_text = "translate English to German: How old are you?"

input_ids = tokenizer(input_text, return_tensors="pt").input_ids.to("cuda")

outputs = model.generate(input_ids)

print(tokenizer.decode(outputs[0]))

INT8 点击展开# pip install bitsandbytes accelerate

from transformers import T5Tokenizer, T5ForConditionalGeneration

tokenizer = T5Tokenizer.from_pretrained("google/flan-t5-base")

model = T5ForConditionalGeneration.from_pretrained("google/flan-t5-base", device_map="auto", load_in_8bit=True)

input_text = "translate English to German: How old are you?"

input_ids = tokenizer(input_text, return_tensors="pt").input_ids.to("cuda")

outputs = model.generate(input_ids)

print(tokenizer.decode(outputs[0]))

用途

直接使用和下游使用

作者在 the original paper's model card 中写道:

主要用途是研究语言模型,包括零样本自然语言处理任务和上下文中的少样本学习自然语言处理任务,如推理和问答;推进公平性和安全性研究,了解当前大型语言模型的限制

有关详细信息,请参阅 research paper 。

超出范围的用途

需要更多信息。

偏见、风险和限制

本节中的下列信息是从模型的 official model card 中复制的:

语言模型,包括Flan-T5,可能会根据Rae等人(2021)的说法以有害的方式用于语言生成。在没有事先评估特定应用程序的安全性和公平性问题的情况下,不应直接在任何应用程序中使用Flan-T5。

伦理考虑和风险

Flan-T5是在未经筛选的明确内容和未评估现有偏见的大量文本数据上进行微调的。因此,模型本身有可能生成同样不适当的内容或复制基础数据中的内在偏见。

已知限制

Flan-T5尚未在实际应用中进行测试。

敏感用途:

不应将Flan-T5应用于任何不可接受的用途,例如生成滥用言论。

训练细节

训练数据

该模型是在一组任务上进行训练的,其中包括原始论文中描述的任务(来自原始论文的表2):

训练过程

根据 original paper 模型卡的描述:

这些模型基于预训练的T5(Raffel et al.,2020),并在指令下进行微调以获得更好的零样本和少样本性能。每个T5模型大小都有一个经过微调的Flan模型。

该模型使用TPU v3或TPU v4机组进行训练,使用 t5x 代码库和 jax 进行微调。

评估

测试数据、因素和指标

作者在各种任务上对模型进行了评估,涵盖了多种语言(共1836种)。请参阅下表中一些定量评估结果:

有关完整详情,请查看

research paper

。

有关完整详情,请查看

research paper

。

结果

有关FLAN-T5-Base的完整结果,请参阅 research paper ,表3。

环境影响

可以使用 Machine Learning Impact calculator 在 Lacoste et al. (2019) 中提供的方法估算碳排放量。

- 硬件类型:Google Cloud TPU Pods - TPU v3或TPU v4 |芯片数≥4。

- 使用时间:需要更多信息

- 云提供商:GCP

- 计算区域:需要更多信息

- 排放碳量:需要更多信息

引用

BibTeX:

@misc{https://doi.org/10.48550/arxiv.2210.11416,

doi = {10.48550/ARXIV.2210.11416},

url = {https://arxiv.org/abs/2210.11416},

author = {Chung, Hyung Won and Hou, Le and Longpre, Shayne and Zoph, Barret and Tay, Yi and Fedus, William and Li, Eric and Wang, Xuezhi and Dehghani, Mostafa and Brahma, Siddhartha and Webson, Albert and Gu, Shixiang Shane and Dai, Zhuyun and Suzgun, Mirac and Chen, Xinyun and Chowdhery, Aakanksha and Narang, Sharan and Mishra, Gaurav and Yu, Adams and Zhao, Vincent and Huang, Yanping and Dai, Andrew and Yu, Hongkun and Petrov, Slav and Chi, Ed H. and Dean, Jeff and Devlin, Jacob and Roberts, Adam and Zhou, Denny and Le, Quoc V. and Wei, Jason},

keywords = {Machine Learning (cs.LG), Computation and Language (cs.CL), FOS: Computer and information sciences, FOS: Computer and information sciences},

title = {Scaling Instruction-Finetuned Language Models},

publisher = {arXiv},

year = {2022},

copyright = {Creative Commons Attribution 4.0 International}

}

模型再利用

使用google/flan-t5-base作为基础模型的 Evaluation on 36 datasets 平均得分为77.98,而google/t5-v1_1-base得分为68.82。作为2023年6月2日google/t5-v1_1-base架构的所有测试模型中排名第一。结果:

| 20_newsgroup | ag_news | amazon_reviews_multi | anli | boolq | cb | cola | copa | dbpedia | esnli | financial_phrasebank | imdb | isear | mnli | mrpc | multirc | poem_sentiment | qnli | qqp | rotten_tomatoes | rte | sst2 | sst_5bins | stsb | trec_coarse | trec_fine | tweet_ev_emoji | tweet_ev_emotion | tweet_ev_hate | tweet_ev_irony | tweet_ev_offensive | tweet_ev_sentiment | wic | wnli | wsc | yahoo_answers |

|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|

| 86.2188 | 89.6667 | 67.12 | 51.9688 | 82.3242 | 78.5714 | 80.1534 | 75 | 77.6667 | 90.9507 | 85.4 | 93.324 | 72.425 | 87.2457 | 89.4608 | 62.3762 | 82.6923 | 92.7878 | 89.7724 | 89.0244 | 84.8375 | 94.3807 | 57.2851 | 89.4759 | 97.2 | 92.8 | 46.848 | 80.2252 | 54.9832 | 76.6582 | 84.3023 | 70.6366 | 70.0627 | 56.338 | 53.8462 | 73.4 |