模型:

h2oai/h2ogpt-oasst1-falcon-40b

英文

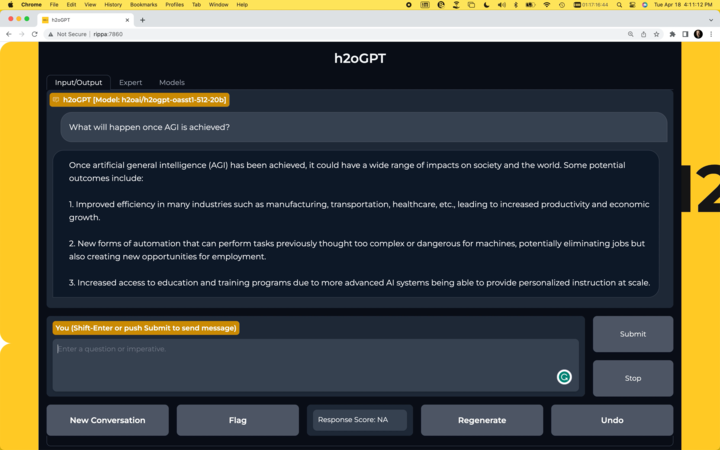

英文h2oGPT 模型卡片

摘要

H2O.ai 的 h2ogpt-oasst1-falcon-40b 是一个拥有 400 亿参数、经过商业许可的指令跟随大型语言模型。

- 基础模型: tiiuae/falcon-40b

- 精调数据集: h2oai/openassistant_oasst1_h2ogpt_graded

- 数据准备和精调代码: H2O.ai GitHub

- 训练日志: zip

- 论文: arxiv.org/abs/2306.08161

聊天机器人

- 运行您自己的聊天机器人:

H2O.ai GitHub

使用方法

要在带有 GPU 的机器上使用 transformers 库与该模型,请确保您已安装以下库。

pip install transformers==4.29.2 pip install accelerate==0.19.0 pip install torch==2.0.1 pip install einops==0.6.1

import torch

from transformers import pipeline, AutoTokenizer

tokenizer = AutoTokenizer.from_pretrained("h2oai/h2ogpt-oasst1-falcon-40b", padding_side="left")

generate_text = pipeline(model="h2oai/h2ogpt-oasst1-falcon-40b", tokenizer=tokenizer, torch_dtype=torch.bfloat16, trust_remote_code=True, device_map="auto", prompt_type="human_bot")

res = generate_text("Why is drinking water so healthy?", max_new_tokens=100)

print(res[0]["generated_text"])

或者,如果您想不使用 trust_remote_code=True,您可以下载 instruct_pipeline.py ,将其存储在与您的笔记本旁边,并根据加载的模型和分词器构建自己的流程:

import torch

from h2oai_pipeline import H2OTextGenerationPipeline

from transformers import AutoModelForCausalLM, AutoTokenizer

tokenizer = AutoTokenizer.from_pretrained("h2oai/h2ogpt-oasst1-falcon-40b", padding_side="left")

model = AutoModelForCausalLM.from_pretrained("h2oai/h2ogpt-oasst1-falcon-40b", torch_dtype=torch.bfloat16, device_map="auto")

generate_text = H2OTextGenerationPipeline(model=model, tokenizer=tokenizer, prompt_type="human_bot")

res = generate_text("Why is drinking water so healthy?", max_new_tokens=100)

print(res[0]["generated_text"])

模型架构

RWForCausalLM(

(transformer): RWModel(

(word_embeddings): Embedding(65024, 8192)

(h): ModuleList(

(0-59): 60 x DecoderLayer(

(ln_attn): LayerNorm((8192,), eps=1e-05, elementwise_affine=True)

(ln_mlp): LayerNorm((8192,), eps=1e-05, elementwise_affine=True)

(self_attention): Attention(

(maybe_rotary): RotaryEmbedding()

(query_key_value): Linear(in_features=8192, out_features=9216, bias=False)

(dense): Linear(in_features=8192, out_features=8192, bias=False)

(attention_dropout): Dropout(p=0.0, inplace=False)

)

(mlp): MLP(

(dense_h_to_4h): Linear(in_features=8192, out_features=32768, bias=False)

(act): GELU(approximate='none')

(dense_4h_to_h): Linear(in_features=32768, out_features=8192, bias=False)

)

)

)

(ln_f): LayerNorm((8192,), eps=1e-05, elementwise_affine=True)

)

(lm_head): Linear(in_features=8192, out_features=65024, bias=False)

)

模型配置

RWConfig {

"_name_or_path": "h2oai/h2ogpt-oasst1-falcon-40b",

"alibi": false,

"apply_residual_connection_post_layernorm": false,

"architectures": [

"RWForCausalLM"

],

"attention_dropout": 0.0,

"auto_map": {

"AutoConfig": "tiiuae/falcon-40b--configuration_RW.RWConfig",

"AutoModel": "tiiuae/falcon-40b--modelling_RW.RWModel",

"AutoModelForCausalLM": "tiiuae/falcon-40b--modelling_RW.RWForCausalLM",

"AutoModelForQuestionAnswering": "tiiuae/falcon-40b--modelling_RW.RWForQuestionAnswering",

"AutoModelForSequenceClassification": "tiiuae/falcon-40b--modelling_RW.RWForSequenceClassification",

"AutoModelForTokenClassification": "tiiuae/falcon-40b--modelling_RW.RWForTokenClassification"

},

"bias": false,

"bos_token_id": 11,

"custom_pipelines": {

"text-generation": {

"impl": "h2oai_pipeline.H2OTextGenerationPipeline",

"pt": "AutoModelForCausalLM"

}

},

"eos_token_id": 11,

"hidden_dropout": 0.0,

"hidden_size": 8192,

"initializer_range": 0.02,

"layer_norm_epsilon": 1e-05,

"model_type": "RefinedWeb",

"n_head": 128,

"n_head_kv": 8,

"n_layer": 60,

"parallel_attn": true,

"torch_dtype": "float16",

"transformers_version": "4.30.0.dev0",

"use_cache": true,

"vocab_size": 65024

}

模型验证

使用 EleutherAI lm-evaluation-harness 进行模型验证结果。

| Task | Version | Metric | Value | Stderr | |

|---|---|---|---|---|---|

| arc_challenge | 0 | acc | 0.5196 | ± | 0.0146 |

| acc_norm | 0.5461 | ± | 0.0145 | ||

| arc_easy | 0 | acc | 0.8190 | ± | 0.0079 |

| acc_norm | 0.7799 | ± | 0.0085 | ||

| boolq | 1 | acc | 0.8514 | ± | 0.0062 |

| hellaswag | 0 | acc | 0.6485 | ± | 0.0048 |

| acc_norm | 0.8314 | ± | 0.0037 | ||

| openbookqa | 0 | acc | 0.3860 | ± | 0.0218 |

| acc_norm | 0.4880 | ± | 0.0224 | ||

| piqa | 0 | acc | 0.8194 | ± | 0.0090 |

| acc_norm | 0.8335 | ± | 0.0087 | ||

| winogrande | 0 | acc | 0.7751 | ± | 0.0117 |

免责声明

在使用此存储库中提供的大型语言模型之前,请仔细阅读此免责声明。您使用该模型即表示您同意以下条款和条件。

- 偏见和冒犯性:此大型语言模型是基于多样化的互联网文本数据进行训练的,其中可能包含有偏见、种族主义、冒犯性或其他不适当的内容。通过使用此模型,您承认并接受生成的内容有时可能表现出偏见或产生冒犯或不适当的内容。此存储库的开发人员不支持、不支持或不推广任何此类内容或观点。

- 限制:该大型语言模型是一种基于人工智能的工具,而不是人类。它可能会生成不正确、荒谬或不相关的回答。用户有责任对生成的内容进行批判性评估,并自行决定是否使用它。

- 自行承担风险:使用该大型语言模型的用户必须对使用该工具可能产生的任何后果承担全部责任。本存储库的开发者和贡献者不对因使用或滥用提供的模型而导致的任何损害、损失或伤害承担责任。

- 道德考量:鼓励用户负责任和道德地使用大型语言模型。通过使用该模型,您同意不将其用于促进仇恨言论、歧视、骚扰或任何形式的非法或有害活动。

- 报告问题:如果您发现大型语言模型生成的内容带有偏见、冒犯或其他不适当的内容,请通过提供的渠道向存储库维护者报告。您的反馈将有助于改善模型并减轻潜在问题。

- 免责声明的更改:本存储库的开发者保留随时修改或更新本免责声明的权利,无需事先通知。用户有责任定期查阅免责声明以了解任何更改。

通过使用本存储库提供的大型语言模型,您同意接受并遵守本免责声明中概述的条款和条件。如果您不同意本免责声明的任何部分,您应避免使用该模型和由其生成的任何内容。