模型:

microsoft/focalnet-base

英文

英文FocalNet(小型且具有大感受野的模型)

FocalNet模型在ImageNet-1k数据集上以384x384的分辨率进行了训练。该模型首次在杨等人的论文 Focal Modulation Networks 中提出,并于 this repository 首次发布。

免责声明:发布FocalNet模型的团队并未为该模型撰写模型卡片,因此此模型卡片由Hugging Face团队撰写。

模型描述

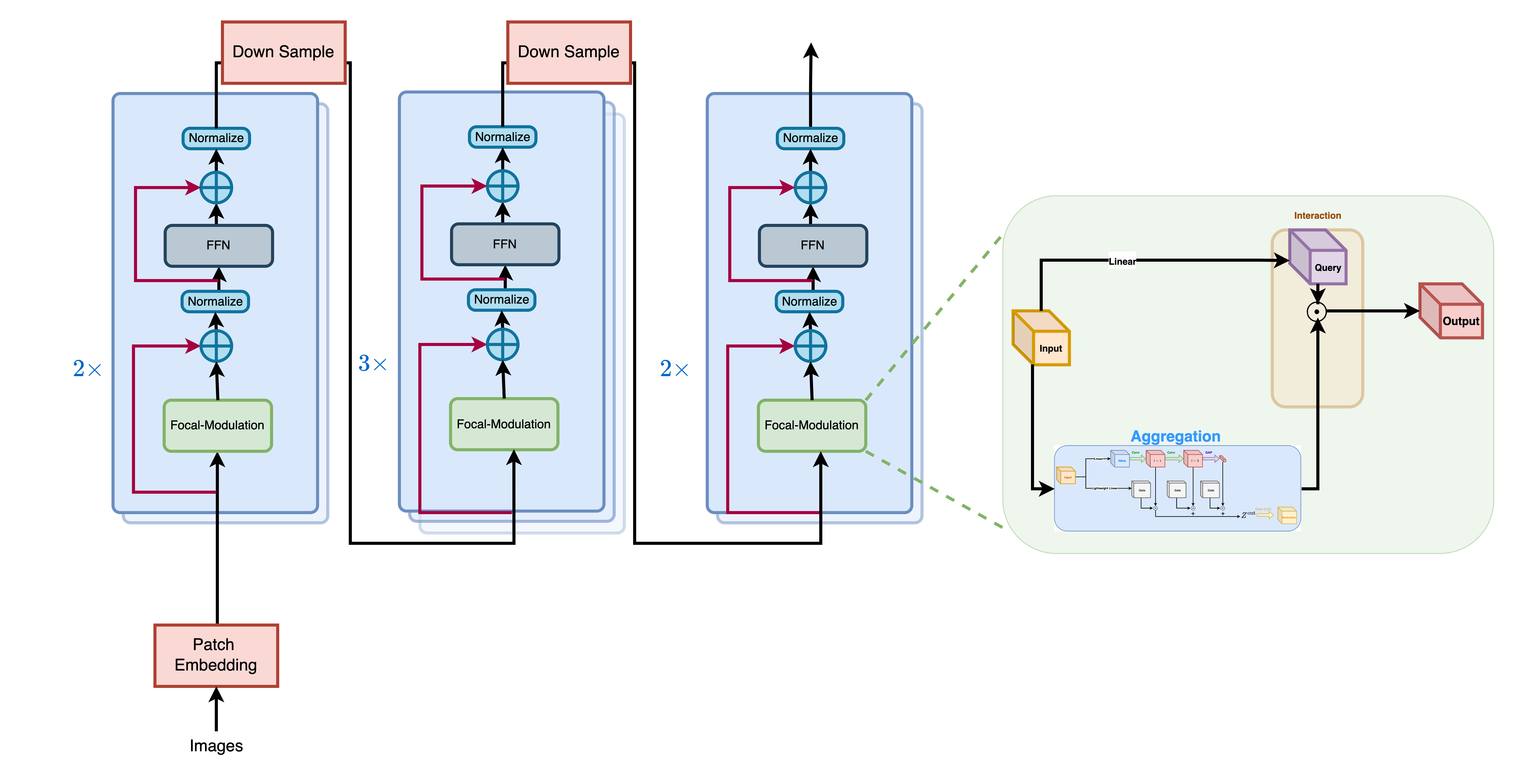

Focal模块化网络是Vision Transformers的一种替代方法,其中自我注意力(SA)完全被焦点调节机制所取代,用于模拟视觉中的令牌交互。焦点调节包括三个组成部分:(i)分层语境建模,使用一系列深度卷积层来编码从短范围到长范围的视觉语境,(ii)门控聚合,根据查询令牌的内容选择性地收集语境,以及(iii)逐元素调节或仿射变换,将聚合的语境注入查询中。大量实验表明,在图像分类、目标检测和分割等任务上,FocalNet相较于最先进的SA对应模型(如Vision Transformers、Swin和Focal Transformers)在相似的计算成本下表现更好。

预期用途及限制

您可以使用原始模型进行图像分类。可参阅 model hub 以查找您感兴趣的任务上的精调版本。

如何使用

以下是使用此模型对COCO 2017数据集中的图像进行分类为1,000个ImageNet类别之一的方法:

from transformers import FocalNetImageProcessor, FocalNetForImageClassification

import torch

from datasets import load_dataset

dataset = load_dataset("huggingface/cats-image")

image = dataset["test"]["image"][0]

preprocessor = FocalNetImageProcessor.from_pretrained("microsoft/focalnet-base")

model = FocalNetForImageClassification.from_pretrained("microsoft/focalnet-base")

inputs = preprocessor(image, return_tensors="pt")

with torch.no_grad():

logits = model(**inputs).logits

# model predicts one of the 1000 ImageNet classes

predicted_label = logits.argmax(-1).item()

print(model.config.id2label[predicted_label]),

如需更多代码示例,请参阅 documentation 。

BibTeX条目和引用信息

@article{DBLP:journals/corr/abs-2203-11926,

author = {Jianwei Yang and

Chunyuan Li and

Jianfeng Gao},

title = {Focal Modulation Networks},

journal = {CoRR},

volume = {abs/2203.11926},

year = {2022},

url = {https://doi.org/10.48550/arXiv.2203.11926},

doi = {10.48550/arXiv.2203.11926},

eprinttype = {arXiv},

eprint = {2203.11926},

timestamp = {Tue, 29 Mar 2022 18:07:24 +0200},

biburl = {https://dblp.org/rec/journals/corr/abs-2203-11926.bib},

bibsource = {dblp computer science bibliography, https://dblp.org}

}