模型:

microsoft/git-large-vatex

英文

英文GIT (GenerativeImage2Text),基于VATEX的大型模型

GIT(GenerativeImage2Text)模型,大型版本,使用VATEX进行了微调。该模型在Wang等人的论文 GIT: A Generative Image-to-text Transformer for Vision and Language 中首次提出,并于 this repository 首次发布。

声明:发布GIT的团队未为该模型编写模型卡片,因此该模型卡片由Hugging Face团队编写。

模型描述

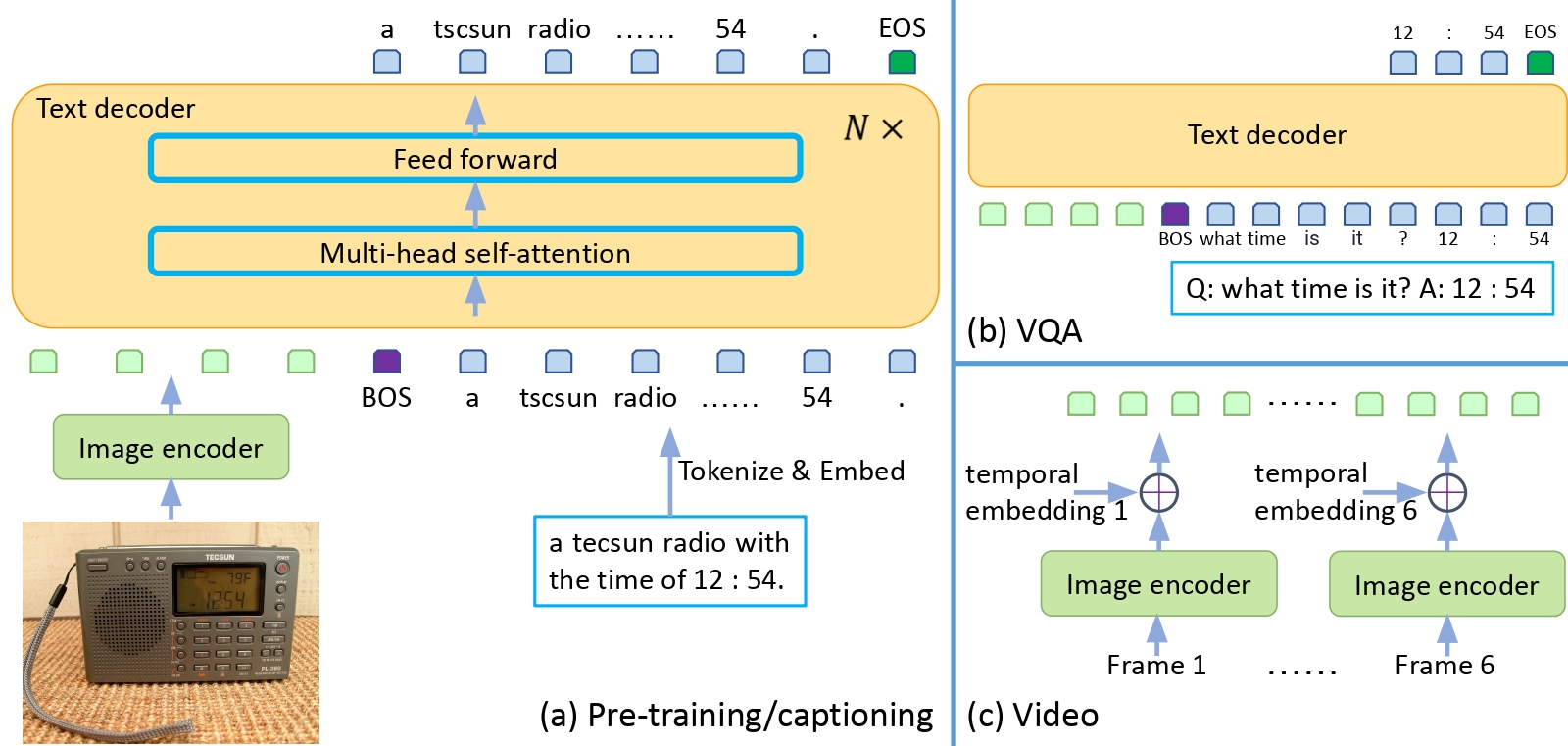

GIT是一个基于Transformer解码器的模型,其条件是CLIP图像令牌和文本令牌。模型使用大量(图像、文本)对进行“教师强制”训练。

该模型的目标仅仅是在给定图像令牌和先前的文本令牌的情况下预测下一个文本令牌。

该模型完全可以访问(即在图像补丁令牌上使用双向注意力掩码),但仅可以访问先前的文本令牌(即在文本令牌上使用因果关注掩码)来预测下一个文本令牌。

这使得模型可以用于以下任务:

- 图像和视频字幕

- 图像和视频的视觉问答(Visual Question Answering,VQA)

- 甚至图像分类(仅需将模型与图像进行条件设置,并要求生成相应的文本类别)

预期用途和限制

您可以使用原始模型进行视频字幕。查看 model hub 以寻找您感兴趣的任务的微调版本。

使用方法

有关代码示例,请参阅 documentation 。

训练数据

来自论文的描述:

我们收集了80亿个图像-文本对进行预训练,其中包括COCO(Lin等,2014年),Conceptual Captions(CC3M)(Sharma等,2018年),SBU(Ordonez等,2011年),Visual Genome(VG)(Krishna等,2016年),Conceptual Captions(CC12M)(Changpinyo等,2021年),ALT200M(Hu等,2021a年)和额外收集了6亿个数据,遵循Hu等人(2021a年)中的类似收集过程。

=> 但是这是针对论文中所指的未公开源代码的"GIT"模型。

此检查点是"GIT-large",它是在2000万个图像-文本对上训练的GIT的较小变体。

接下来,该模型在VATEX上进行了微调。

有关详细信息,请参阅 paper 中的表11。

预处理

关于训练期间的预处理详细信息,请参阅原始存储库。

在验证阶段,调整图像的较短边缘大小后,进行中心裁剪以达到固定分辨率。然后,通过ImageNet的平均值和标准差对RGB通道进行规范化。

评估结果

有关评估结果,请参阅 paper 。