模型:

microsoft/swinv2-base-patch4-window8-256

英文

英文Swin Transformer v2(基于base大小的模型)

Swin Transformer v2模型在256x256分辨率下使用ImageNet-1k数据集进行预训练。它是由Liu等人在论文 Swin Transformer V2: Scaling Up Capacity and Resolution 中提出,并在 this repository 中首次发布。

免责声明:发布Swin Transformer v2的团队没有为该模型撰写模型卡片,因此该模型卡片由Hugging Face团队撰写。

模型描述

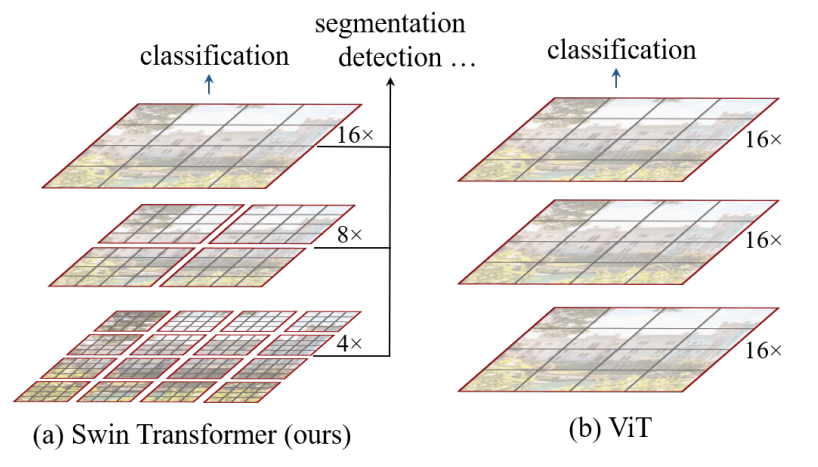

Swin Transformer是一种Vision Transformer模型。它通过在深层中合并图像补丁(以灰色显示)来构建分层特征图,并且由于仅在每个局部窗口(以红色显示)中计算自注意力,其线性计算复杂度针对输入图像大小。因此,它可以作为图像分类和密集识别任务的通用骨干。相反,先前的Vision Transformer仅生成单一低分辨率的特征图,并且由于全局自注意力的计算针对输入图像大小具有二次计算复杂度。

Swin Transformer v2增加了三个主要改进:1)使用余弦注意力的残差后序规范化方法来提高训练稳定性;2)使用对数间距连续位置偏差方法,将使用低分辨率图像进行预训练的模型有效地转移到具有高分辨率输入的下游任务;3)自监督预训练方法SimMIM,以减少对大量标记图像的需求。

预期用途和限制

您可以使用原始模型进行图像分类。请查看 model hub 以寻找您感兴趣的任务的精调版本。

如何使用

这是如何使用此模型将COCO 2017数据集中的图像分类为1,000个ImageNet类别之一的示例:

from transformers import AutoImageProcessor, AutoModelForImageClassification

from PIL import Image

import requests

url = "http://images.cocodataset.org/val2017/000000039769.jpg"

image = Image.open(requests.get(url, stream=True).raw)

processor = AutoImageProcessor.from_pretrained("microsoft/swinv2-base-patch4-window8-256")

model = AutoModelForImageClassification.from_pretrained("microsoft/swinv2-base-patch4-window8-256")

inputs = processor(images=image, return_tensors="pt")

outputs = model(**inputs)

logits = outputs.logits

# model predicts one of the 1000 ImageNet classes

predicted_class_idx = logits.argmax(-1).item()

print("Predicted class:", model.config.id2label[predicted_class_idx])

更多代码示例,请参考 documentation 。

BibTeX条目和引用信息

@article{DBLP:journals/corr/abs-2111-09883,

author = {Ze Liu and

Han Hu and

Yutong Lin and

Zhuliang Yao and

Zhenda Xie and

Yixuan Wei and

Jia Ning and

Yue Cao and

Zheng Zhang and

Li Dong and

Furu Wei and

Baining Guo},

title = {Swin Transformer {V2:} Scaling Up Capacity and Resolution},

journal = {CoRR},

volume = {abs/2111.09883},

year = {2021},

url = {https://arxiv.org/abs/2111.09883},

eprinttype = {arXiv},

eprint = {2111.09883},

timestamp = {Thu, 02 Dec 2021 15:54:22 +0100},

biburl = {https://dblp.org/rec/journals/corr/abs-2111-09883.bib},

bibsource = {dblp computer science bibliography, https://dblp.org}

}