模型:

microsoft/xclip-base-patch16-zero-shot

英文

英文X-CLIP (基础尺寸模型)

X-CLIP模型(基础尺寸,补丁分辨率为16)在 Kinetics-400 上进行了训练。它由Ni等人在 Expanding Language-Image Pretrained Models for General Video Recognition 论文中介绍,并在 this repository 首次发布。

该模型使用每个视频的32帧,分辨率为224x224进行训练。

免责声明:发布X-CLIP的团队没有为该模型编写模型卡片,因此此模型卡片由Hugging Face团队编写。

模型描述

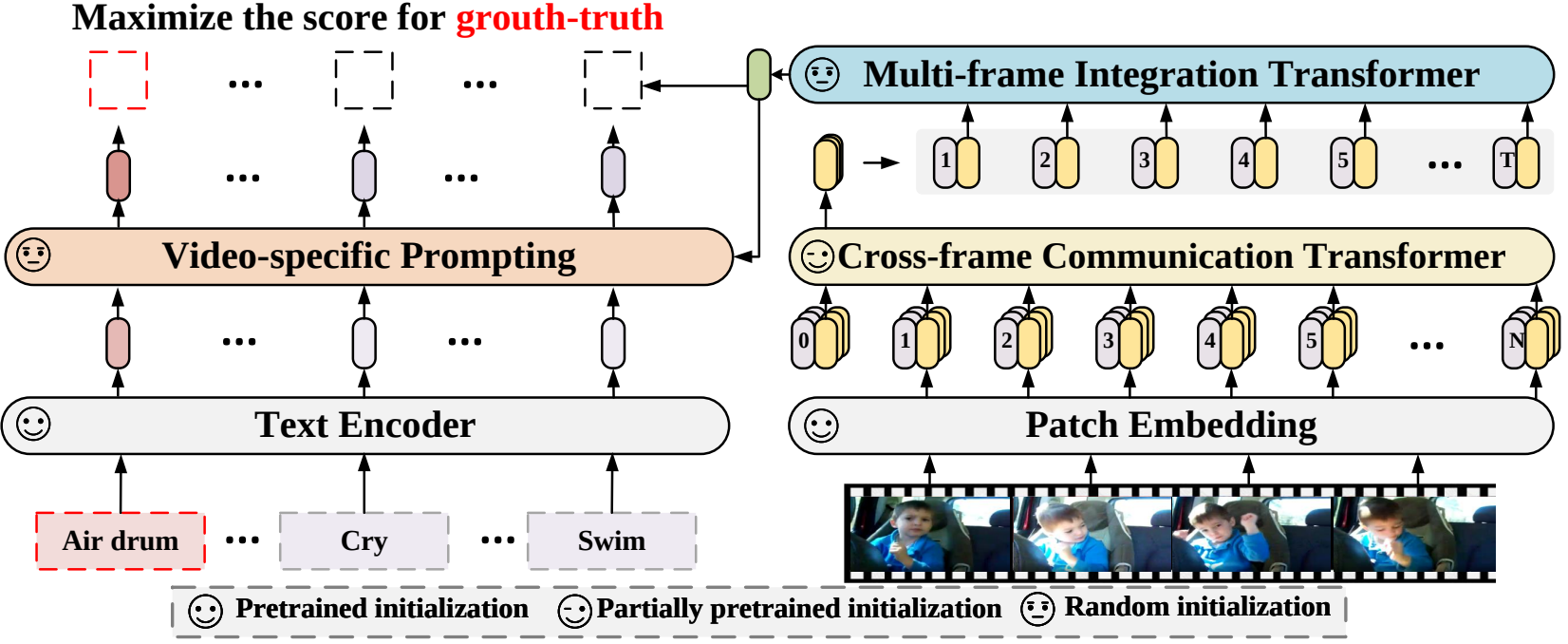

X-CLIP是 CLIP 的一个最小扩展,用于进行视频与文本的通用理解。该模型通过对(视频,文本)对进行对比训练。

这使得该模型可以用于零样本、少样本或完全监督的视频分类和视频文本检索等任务。

预期用途和限制

您可以使用原始模型来确定给定视频与文本的匹配程度。查看 model hub 以寻找您感兴趣的任务的微调版本。

使用方式

有关代码示例,我们推荐查看 documentation 。

训练数据

该模型在 Kinetics 400 上进行了训练。

预处理

关于训练期间预处理的详细信息可以在 here 中找到。

关于验证期间的预处理的详细信息可以在 here 中找到。

在验证期间,首先调整每帧较短边的大小,然后执行中心裁剪以固定尺寸分辨率(如224x224)。接下来,使用ImageNet的均值和标准差对RGB通道进行归一化。

评估结果

该模型在HMDB-51上的零样本前1准确率为44.6%,UCF-101为72.0%,Kinetics-600为65.2%。